okanyanさんのエントリより

http://blog.goo.ne.jp/okanyan/e/97c5fb391731aaf552c100f4d09a7513

>エンジニア側は,当然システム更新時には様々な障害を想定した「危機管理マニュアル」を事前に作成し,トラブルに応じた対応を行っているはずです。

そうなっている「はず」なんですが...

残念ながら多くの企業ではその「はず」が実現していないのが実情なんですね。

弊ブログ子が過去かかわった上場企業のシステムは例外なく「遺漏あり」の管理マニュアルばかりでした。たぶんこの部分では障害が起きない「はず」という前提で作られていたりして、結果的にその起きないはずの箇所で障害が起こったという事例には事欠かないというところです。

たとえば全世界に名をとどろかすグローバル企業S社の某システム。メインのサーバこそサンのン百万円もする電源まで二重系化された重厚なもの。ところが実際に運用に入って1ヶ月ほどで大規模障害が。

ダウンしたのはサブシステムを受け持つ安価なRAID装置。RAID5だから万一HDDに障害が発生してもホットプラグで即座に交換すればOK、というマニュアルだったのですが、実際にはRAID装置本体が故障。すべてのデータが一瞬で失われました。もちろんテープバックアップは月に1度だけなので、まるまる一ヶ月近くのデータがパーに。

おまけに予算の関係(この会社、名前の立派さとは裏腹にいかに徹底的にコストを掛けずにプロダクトを作るかが重視されているのは業界で有名らしい)で、超チープなメーカー(社員が1桁の零細)のRAID装置だったため、サポート(宣伝文句では「完璧」の2文字が踊っていた(笑))がほぼゼロ。再度同じ装置を調達するのに2週間以上かかる始末。

で、その間サブシステムにかかわる部分のサービスは完全停止に追い込まれた、というわけです。

自信満々で鼻持ちならないほど天狗だったこのサブシステム担当者の鼻先が見事にへし折られたのにはなんともいえないものを感じたのは昨日のことのよう。

他にもこの手の話は山ほどあるのですが、結論としては100%とまらないシステムを作っている企業はむしろ例外といえるのでは、ということです。

最新の画像[もっと見る]

-

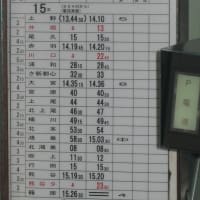

2005年の高崎線平日行路

12年前

2005年の高崎線平日行路

12年前

-

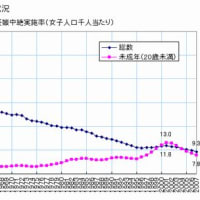

なるほど納得な話

14年前

なるほど納得な話

14年前

-

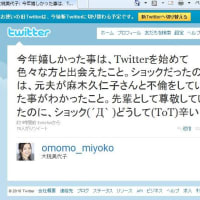

大桃美代子

14年前

大桃美代子

14年前

-

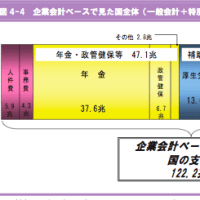

いよいよ来年度は特別会計に手がつけられる

15年前

いよいよ来年度は特別会計に手がつけられる

15年前

-

夢

15年前

夢

15年前

-

E5系ロールアウト

15年前

E5系ロールアウト

15年前

-

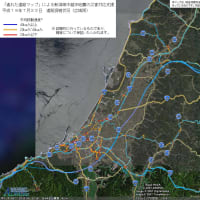

災害時に通行可能な道路の情報

17年前

災害時に通行可能な道路の情報

17年前

-

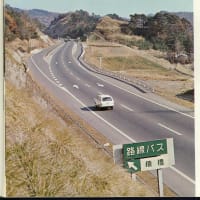

2車線対面通行時代の中央高速

18年前

2車線対面通行時代の中央高速

18年前

-

当該記事が削除されましたので

19年前

当該記事が削除されましたので

19年前

-

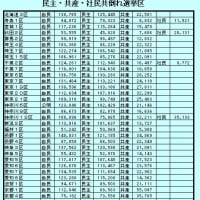

野党共倒れ選挙区一覧

19年前

野党共倒れ選挙区一覧

19年前

サーバのハード上の障害といえば,多くがRAID関係では,っていうのが経験則上の感触です。確かに,サーバ本体には金かけていますが,RAIDって消耗品的な扱いしかしていないような気がします。

予算ケチるならもうちょっと違うだろう,と思ったりします(むしろ,UPSケチってちょとグレード下げた方がまだ被害が少ないのでは,って思います。もちろん,これもケチりすぎると痛い目に遭いますが。)。