Kinect SDK 1.5付属のFacetrackingサンプルプログラムを改造して、顔の回転角をTCPへ出力してみた。

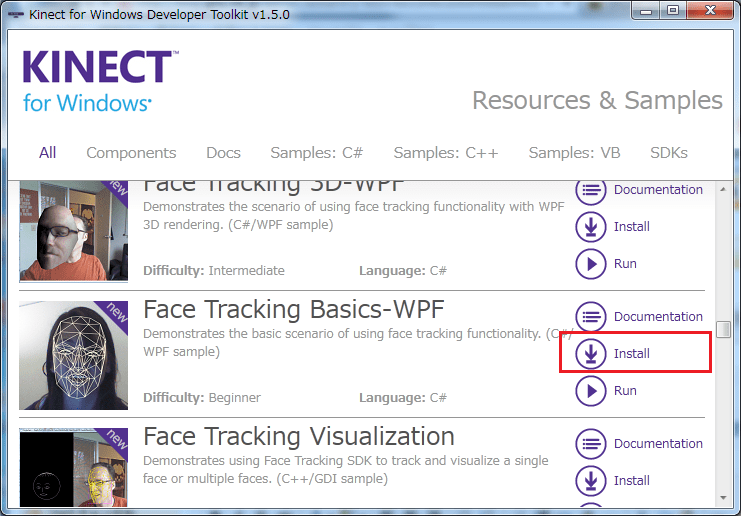

【手順1】サンプルプログラムのソースをインストールする。

”FaceTrackingBasics-WPF”を適当なディレクトリにインストールする。

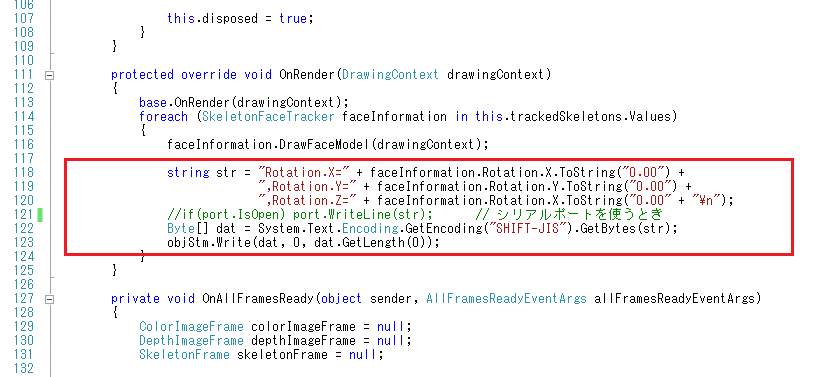

【手順2】プログラムを改造する。

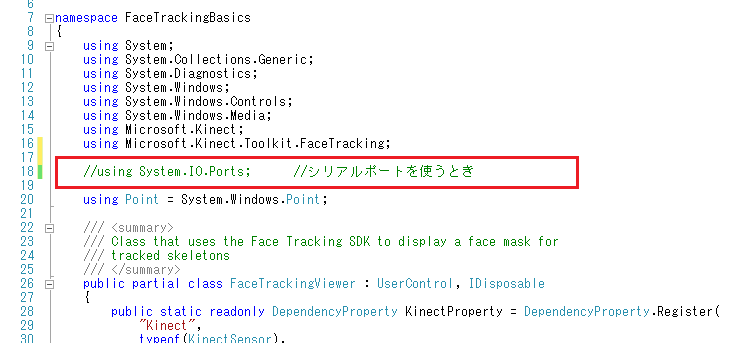

”FaceTrackingBasics-WPF”のソリューションを開く。

”FaceTrackingViewer.xaml.cs”を開き、下記赤枠のように追加する。

参考として、シリアルポートに出力する例もコメントに入れてある。

注意:異常処理は手抜きしているので必要に応じて追加してください。

------------------------------ 途中省略 --------------------------------------

------------------------------ 途中省略 --------------------------------------

------------------------------ 途中省略 --------------------------------------

------------------------------ 途中省略 --------------------------------------

【手順3】動作確認

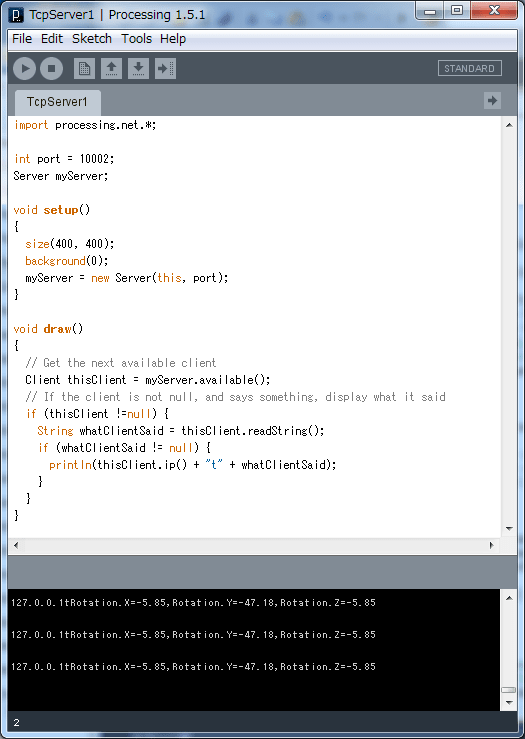

動作確認には、ProcessingのReferenceに載っているサンプルプログラムをそのまま使用した。

このProcessingのTCPサーバーを起動後、FaceTrackingBasics-WPFを起動する。

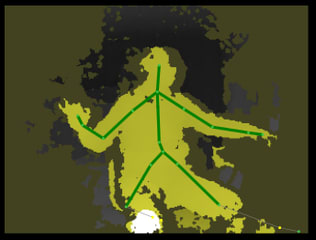

うまく行けばこのようになるはず。

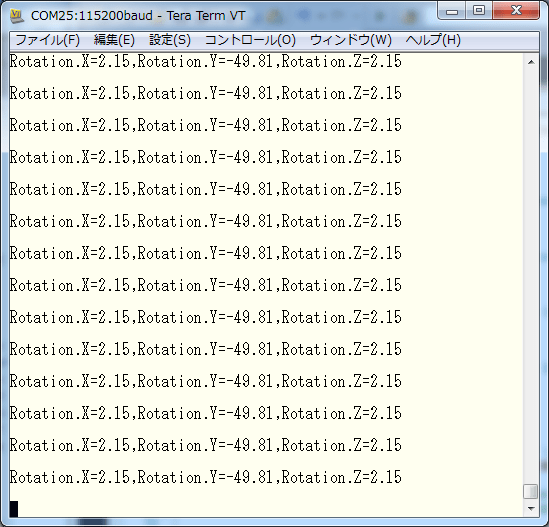

シリアルポートに出力するようにしたときはこんな感じ。

【応用例1】

この記事の改造例をベースに、さらに手を加えてRCサーボモータでWebCameraのパン・チルトを制御してみた。

RCサーボモータの制御にはこれを使っている。

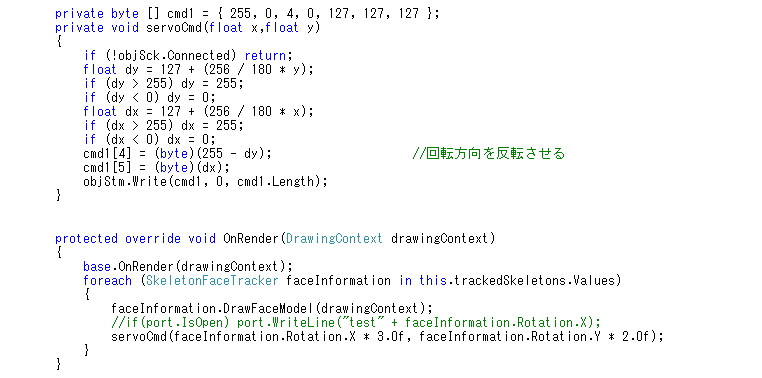

追加の修正個所はこんな感じ。 (2012.9.16追記)

通信コマンドの詳細はこちらを参照してください。

" faceInformation.Rotation.X"と"faceInformation.Rotation.Y"に掛けている係数は、動かしてみて調整する。

【応用例2】

この記事の改造例をベースに、シリアル通信でWebCameraのパン・チルトを制御してみた。

こちらはシリアルコマンド方式サーボモータを使用している。

― 以上 -

関連する記事

・RCサーボモータをmbed+LAN+ProcessingでGUI制御(その1) 【mbed編】

・RCサーボモータをArduinoとProcessingでGUI制御(その1) 【Arduino編】

参考にしたリンク