共生

「民主主義とは?」

対話型人工知能(AI)「チャットGPT」

に聞くと答えが返ってきた。

「民主主義は、国家や社会の政治体制

の1形態を指す用語。

政治的な権力を人々によって行使

されるという原則に基づいている。」

さらに

[平等な参加]や[多数決による決定]

など箇条書きで民主主義の[基本原則]

を詳細に説明した。

続いて、

民主主義の[良い点]を問うと、

「個人の自由と権利の保護」

などを挙げ、

[悪い点]を問うと、

「決定の遅さ」、「多数派の専制」

などを挙げた。

まるで人間が書いたような自然な

文章である。

米新興企業「オープンAI」が1昨年、

生成AIの1種である「チャットGPT」

を公開すると、その利便性から一気

に世界で普及した。

学生や企業は論文や会議録の作成、

調査や翻訳など幅広い作業に活用

する。

業務が効率化すれば、人間は別の

創造的な仕事に注力できる可能性

が大きくなる。

一方で、個人情報流出や著作権侵害

のリスクも浮上した。

民主主義への影響はどうか?

日本の国会では野党議員がチャット

GPTで作成した質問をし、当時の

経済産業相は答弁作成に利用する

可能性に言及した。

米調査会社は昨年の「10大リスク」

の3位にAIの進歩を挙げ、

「民主主義を弱体化させる」

と警告した。

進化

「人は言葉を操り、思考する。

AIもまた、言語を支配し、

文明化へのマスターキーを

獲得しようとしている」

とイスラエルの著名歴史家が

言及した。

では、AIはどのように言語を

操るのか?

生成AIは膨大な情報を取り込ん

で学習し、画像や文章などを

生み出す。

チャットGPTも記事や学術論文

など幅広いテキストデータで

学習したとされる。

文章として出力する際、

「むかしむかし」

という言葉の後には

「あるところに」

と続くように、事前学習から

確率的に最も適切と思われる

言葉を予測し繋ぐ作業を行う

のだ。

チャットGPTは当初、学習した

2021年までのデータ以外の情報

に対応できなかったが、最近は

部分的にネット検索で最新情報

も加えて回答できるようになった。

米マイクロソフトやGoogleも生成

AIを組み込んだネット検索などの

サービスを発表した。

生成AIは刻々と進化している。

問題は、質問事項に関する十分な

データがない場合や学習に使った

データに誤りや虚偽が含まれれば、

回答の内容が誤ったり、偏ったり

することだ。

米マイクロソフトは16年、旧Twitter

でやり取りできるAI「Tay」を公開

した。

だが、ユーザーとの会話から学習

してヘイトスピーチを繰り返すよう

になり、1日足らずで停止された。

チャットGPTは不適切な内容を学習

データから削除するとしているが、

懸念は振り拭えない。

警戒

AIも人間と同様に必ずしも正しい

判断ができるわけではない。

AIに思考まで頼り過ぎれば、一人

一人を判断の主体とみなす民主

主義の前提は揺らぐ。

日本の人口知能学会は、昨年に

発表した声明で

「出力したものを鵜呑みにせず、

長短所を理解した上で利用する

ことが大切」

と強調した。

生成AIの無秩序な開発への警戒

も強い。

米非営利団体は昨年、6ヶ月間の

開発停止を呼びかける公開書簡を

発表し、世界の研究者ら3万人

以上が署名した。

書簡にはこうある。

「やがて数で勝り、より賢く、

私たちに取って変わるかも

しれない非人間的な知性を

開発すべきなのか?

文明のコントロールを失う

危険を冒すべきなのか?」

AIは民意を「支配」するのか?

チャットGPTにさらに問いかけて

みた。

「生成AIが民主主義に与える悪影響

は何か?」

回答の1つがこれだ。

「AIによる自動化や自立的な意思

決定が進む場合、誰が責任を持つ

のか、誰が意思決定の最終的な

判断を下すのかという問題が生じ、

民主主義の原則や倫理的な問題に

ついて再評価が求められる。」

民主主義において、判断と責任の

主体は人間でなくて良いのか?

昨年開かれた先進7カ国首脳会議

(G7広島サミット)は

「信頼できるAI」

の実現に向け、民主主義的価値観

に沿った指針を策定することで

合意した。

デジタルとの共生では、発達する

デジタル社会における政治のあり方

や民主主義に突きつけられる課題、

新たな可能性などについて考えて

いく必要がある。

機械

「米国防総省(ペンタゴン)近くで

爆発、黒煙」

そんな画像が昨年、交流サイト

(SNS)上を駆け巡った。

旧ツイッターが信頼性を担保

する「認証」アカウントに転載

されて拡散し、一部メディアも

これを引用して報じた。

ニューヨーク株式市場では、ダウ

工業株30種平均の株価が一時80

ドル近く急落した。

黒鉛に包まれるペンタゴンは、

人工知能(AI)で生成されたと

みられるフェイク(偽)画像で

あった。

現在AIが創出する画像や映像は、

即座に真贋を判別できないほど

精緻だ。

AIの「技」をそこまで磨いたのが

「機械学習」だ。

人間にとって「学び」をコンピュー

ターに行わせる機械学習は、大量の

データを読み込ませ一定の計算方法

(アルゴリズム)に従ってデータに潜む

パターンやルールを発見させる。

それを新たなデータに当てはめて

識別したり、物事を予測したりする。

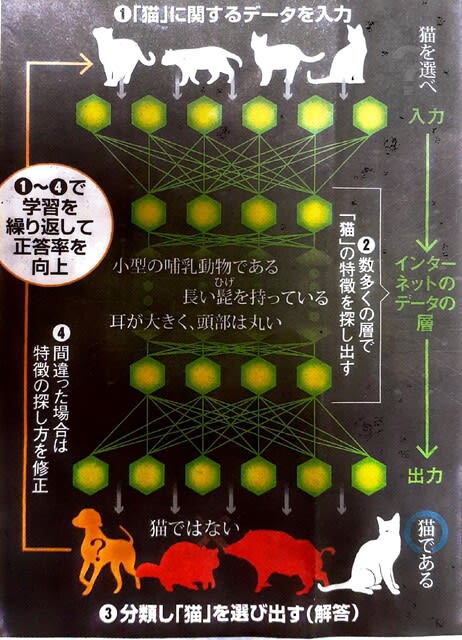

機械学習の中でも特に発展が著しく、

応用が進んでいるのが深層学習

(ディープラーニング)だ。

人間の脳内で神経細胞(ニューロン)

が連なる構造を数理的にモデル化し、

再現した、

「ニューラルネットワーク」

が使われている。

①データを受け取る入力層、

②情報を受け継ぎさまざまな

計算を行う複数の中間層、

③解を提示する出力層、

など、多層的な構造を持つ。

深層

例えば猫。

それがどういうものかを教える

のは人間ではない。

AIが大量の画像を取り込み、

特徴を認識し、猫を識別できる

ようになる。

豊富なデータ量と、コンピュー

ターの処理能力向上が為せる

技である。

深層学習によって、画像や音声

データの解析精度が上がり、

人間を超えるケースが出てきた。

画像から病気を発見したり、

コンクリートの劣化を判定

する。

2017年には、深層学習を用いた

Googleの囲碁AI

「アルファ碁」

が、人類最強と言われるプロ棋士

に勝利し、世界に衝撃を与えた。

人間の仕事がAIに取って代わられ

るのでは?

そんな危機感とともに懸念が深まる

のが深層学習を利用して生成された

本物と区別がつかないようなフェイク

動画や画像、音声だ。

それは民主主義の根幹さえも揺さぶる。

原則

満面の笑みをたたえた米民主党の

大統領のジョー・バイデンと

副大統領のカマラ・ハリス。

昨年に行われたバイデンの2024年

大統領選への再選出馬表明に合わせ、

ライバルの共和党がAIで生成し公開

した宣伝動画だ。

再選を喜んでいるかのようなシーン

に続き、こんなテロップが流れる。

「最弱の大統領が再選されたら

どうなる?」

株価暴落、薬物の蔓延、押し

寄せる不法移民、中国の台湾

侵攻・・。

人工画像とナレーションで描か

れる米国の混迷に、バイデンが

思い悩むような場面で30秒ほど

の動画が終わる。

24年大統領選は、AIが本格的に

活用される初めての選挙となる。

今回、公開された動画には、

小さく

「AIが作成した動画」

との注意が添えられていた。

民主党は「捏造だ」と非難するが、

共和党側は意に介さず、選挙戦を

通じてAIを利用する計画だ。

SNSをなどを通じて、AIが生成

したフェイクが拡散されれば、

世論の扇動や政治への干渉に

利用されかねない。

AIは福音であり、リスクでもある。

その境界線を引くのは難しいが、

共存は避けて通れない。

科学技術振興機構・研究開発戦略

センターのフェローは話す。

「集合知として、より良い判断や、

より良い民主主義につなげるには、

どのような仕組みを作ればよいか、

それを考える研究が重要になって

いくだろう。」

米SF作家のアイザック・アシモフは

1950年作品の中でロボットが従う

3原則を提示した。

曰く、

①人間に危害を加えないこと。

②人間に与えられた命令には服従

すること。

③それらに反しない限りは自己を

守ること。

防ぐべきは科学の暴走ではなく、

科学を操るべき人間にあるのでは

ないか?

AIについても、新たな原則を考える

べき時が来ている。